Ang Seguridad ng Mga Cryptocurrencies na Batay sa Artipisyal na Intelihensiya

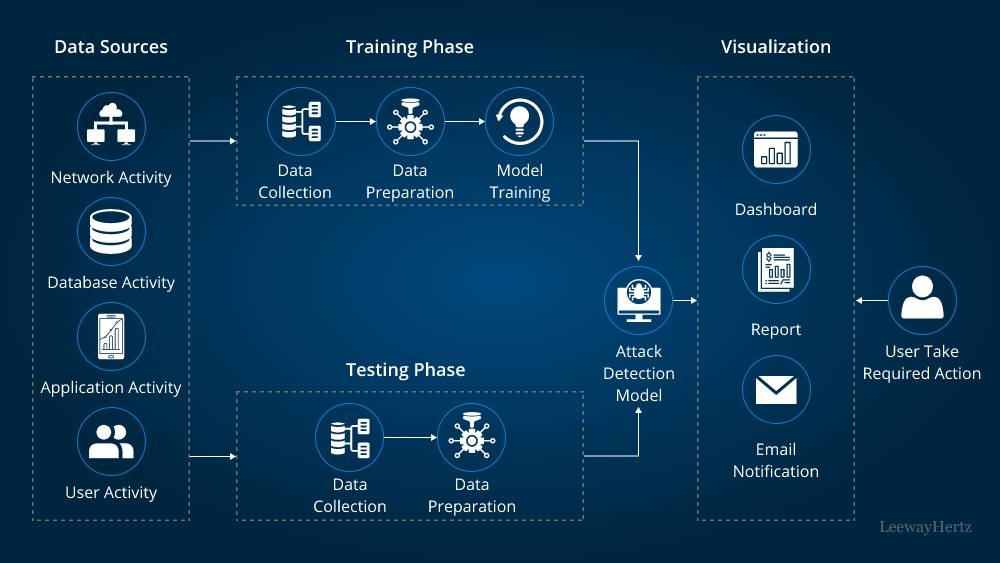

Ang seguridad ng mga cryptocurrencies na batay sa artipisyal na intelihensiya ay hindi na lamang tungkol sa mga smart contract at pribadong susi. Kapag ang isang token, protocol, o “produkto ng crypto” ay umaasa sa mga modelo ng AI—pag-predict ng presyo, pagsusuri ng panganib, automated na paggawa ng merkado, lohika ng liquidasyon, pagtuklas ng pandaraya, o mga autonomous na ahente—kumuha ka ng dalawang uniberso ng seguridad nang sabay: seguridad ng blockchain at seguridad ng AI/ML. Ang mahirap ay ang mga unibersong ito ay bumabagsak ng magkaibang paraan: ang mga blockchain ay bumabagsak ng malakas (mga exploit sa chain), samantalang ang mga sistema ng AI ay madalas na bumagsak nang tahimik (masamang desisyon na mukhang “plausible”). Sa gabay na ito, magtatayo tayo ng isang praktikal na modelo ng banta at isang depensibong plano na maaari mong gamitin—pati na rin ipakita kung paano nakakatulong ang isang estruktural na workflow ng pananaliksik (halimbawa, gamit ang SimianX AI) upang i-validate ang mga assumption at bawasan ang mga blind spot.

Ano ang itinuturing na isang “AI-based cryptocurrency”?

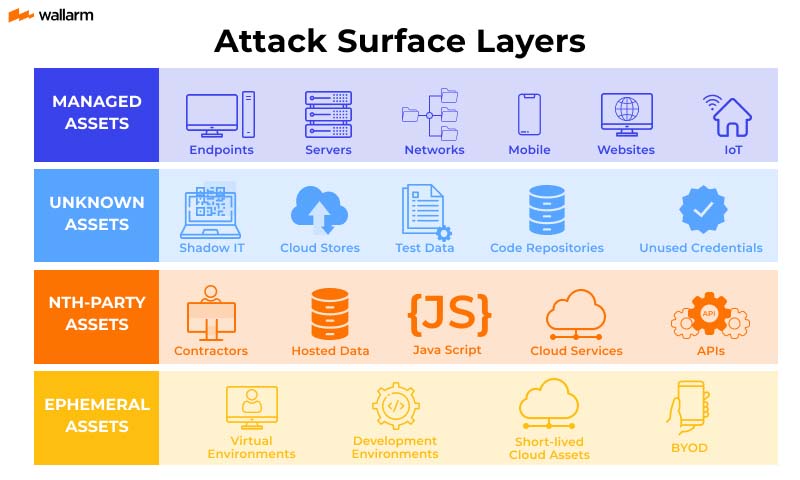

Ang “AI-based cryptocurrency” ay ginagamit ng maluwag online, kaya nagsisimula ang pagsusuri ng seguridad sa isang malinis na depinisyon. Sa praktika, ang mga proyekto ay karaniwang nahuhulog sa isa (o higit pang) mga kategorya:

- AI sa protocol: Ang AI ay direktang nakakaapekto sa lohika ng on-chain (halimbawa, mga update ng parameter, dynamic na bayad, mga limitasyon ng panganib, mga factor ng collateral).

- AI bilang oracle: ang isang off-chain na modelo ay gumagawa ng mga signal na nagbibigay ng input sa mga contract (halimbawa, pagkasumpungin, mga score ng pandaraya, mga tier ng panganib).

- AI agents bilang mga operator: mga autonomous na bot na namamahala ng treasury, nagsasagawa ng mga estratehiya, o nagpapatakbo ng mga keeper/liquidation.

- AI token ecosystems: ang token ay nagbibigay insentibo para sa data, compute, pagsasanay ng modelo, mga pamilihan ng inference, o mga network ng ahente.

- AI-branded tokens (led ng marketing): minimal na depende sa AI; ang panganib ay pangunahing nauugnay sa pamamahala, likididad, at mga smart contract.

Security takeaway: mas malaki ang epekto ng output ng AI sa value transfer (liquidations, mint/burn, collateral, paggalaw ng treasury), mas kailangan ituring ang AI pipeline bilang kritikal na imprastruktura, hindi lang “analytics.”

Sa sandaling ang output ng modelo ay maaaring mag-trigger ng mga pagbabago sa on-chain state, ang integridad ng modelo ay nagiging integridad ng pera.

Isang layered threat model para sa AI-based crypto security

Isang kapaki-pakinabang na framework ay ituring ang mga AI-based na crypto systems bilang limang magkakabit na layer. Kailangan mo ng kontrol sa bawat layer dahil pinipili ng mga umaatake ang pinakamahina.

| Layer | Ano ang kasama | Karaniwang failure mode | Bakit natatangi ito sa AI-based crypto |

|---|---|---|---|

| L1: On-chain code | mga kontrata, pag-upgrade, access control | maaring ma-exploit na bug, pang-aabuso ng admin | hindi na mababawi ang value transfer |

| L2: Oracles & data | price feeds, on-chain events, off-chain APIs | manipuladong inputs | umaasa ang AI sa kalidad ng data |

| L3: Model & training | datasets, labels, training pipeline | poisoning, backdoors | ang modelo ay maaaring “tama tignan” pero mali |

| L4: Inference & agents | endpoints, agent tools, permissions | prompt injection, pang-aabuso ng tool | ang mga “desisyon” ng agent ay maaaring pilitin |

| L5: Governance & ops | keys, multisig, monitoring, incident response | mabagal na reaksyon, mahihinang kontrol | karamihan ng “AI failures” ay operational |

Mga pangunahing panganib sa seguridad (at kung ano ang nagpapabago sa AI-based crypto)

1) Ang mga vulnerabilities ng smart contract ay nananatiling nangingibabaw—maaaring palakihin ng AI ang blast radius

Ang mga klasikong isyu (re-entrancy, mga error sa access control, mga bug sa upgrade, manipulasyon ng oracle, precision/rounding, MEV exposure) ay nananatiling #1. Ang twist ng AI ay na ang AI-driven automation ay maaaring mag-trigger ng mga pagkakamaling ito nang mas mabilis at mas madalas, lalo na kapag ang mga agent ay tumatakbo 24/7.

Defenses

- Mag-require ng independyenteng audit (mas mainam kung marami) at patuloy na pagmamanman.

- Mas mainam ang pinababang awtoridad sa pag-upgrade (timelocks, multi-sigs, emergency pause na may mahigpit na saklaw).

- Magdagdag ng circuit breakers para sa mga aksyon na tinutulungan ng AI (rate limits, max-loss caps, stepwise parameter updates).

- Panatilihin ang mga high-risk na aksyon sa likod ng human-in-the-loop na mga aprobasyon kapag makabuluhan ang TVL.

2) Oracle at manipulasyon ng data—ngayon ay may “AI-friendly” na poisoning

Hindi laging kailangan ng mga uma-atake na sirain ang chain; maaari nilang baluktutin ang mga input ng modelo:

- Wash trading upang impluwensyahan ang volume/volatility signals

- Coordinadong social spam upang baguhin ang sentiment features

- Pag-iinject ng mga gawa-gawang pattern upang manipulahin ang anomaly detectors

- Pag-feed ng maling “ground truth” labels sa community-labeled datasets

Ito ay data poisoning, at delikado ito dahil maaaring magpatuloy ang modelo sa pagpapasa ng normal na metrics habang tahimik na natututo ng behavior na pinili ng uma-atake.

Defensa

- Gumamit ng multi-source data validation (cross-check mula sa mga exchanges, on-chain na venue, at mga independenteng provider).

- Mag-aplay ng matibay na statistics (trimmed means, median-of-means) at outlier filtering.

- Panatilihin ang signed datasets at provenance logs (hashing, versioning, access controls).

- Magkaroon ng “golden set” ng mga verified na kaganapan upang matukoy ang drift at poisoning.

Kung hindi mo kayang patunayan kung saan nanggaling ang mga input ng modelo, hindi mo kayang patunayan kung bakit ganoon ang ugali ng protocol.

3) Adversarial ML attacks—evasion, backdoors, at model extraction

Maaaring atakihin ang mga AI modelo sa mga paraang hindi mukhang tradisyunal na “hacks”:

- Evasion attacks: mga input na ginawa upang makaiwas sa fraud detection o risk scoring (halimbawa, mga perturbasyon sa transaction graph).

- Backdoors: ang poisoned na training ay nagdudulot ng mga partikular na trigger na magbibigay ng mga output na paborable sa uma-atake.

- Pagkuha ng modelo: paulit-ulit na mga query upang tantyahin ang modelo, pagkatapos ay gamitin ito o makipagkompetensya dito.

- Pagtukoy sa kasapi / leakage ng privacy: ang modelo ay naglalabas kung ang ilang data points ay nasa training.

Mga Depensa

- Threat-model ang modelo: anong mga output ang sensitibo, sino ang pwedeng mag-query, anong mga rate limits ang umiiral?

- Pagtibayin ang mga inference endpoints:

rate limiting, auth, anomaly detection, query budgets.

- Magpatakbo ng red-team evaluation gamit ang adversarial testing bago ang paglunsad at pagkatapos ng mga update.

- Para sa sensitibong training data: isaalang-alang ang differential privacy, secure enclaves, o mga constrained feature sets.

4) Prompt injection at pang-aabuso ng tool sa AI agents

Kung ang mga agent ay pwedeng tumawag ng mga tool (trade, bridge, sign, post governance, update parameters), maaari silang ma-atake sa pamamagitan ng:

- masasamang inputs na magdudulot ng mga mapaminsalang aksyon ng agent

- “instruction hijacking” gamit ang panlabas na nilalaman (mga web page, mensahe sa Discord, PDFs)

- maling paggamit ng tool (pagtawag ng maling function gamit ang tamang hitsurang payload)

Mga Depensa

- Pinakamababang pribilehiyo: hindi dapat magkaroon ng walang limitasyong signing authority ang mga agent.

- Hatiin ang mga pahintulot: paghiwalayin ang “analisis” mula sa “pagpapatupad”.

- Gumamit ng allowlists para sa mga tool at destinasyon (mga aprubadong kontrata, chains, ruta).

- Mag-require ng confirmations para sa mga mataas na panganib na aksyon (multisig threshold, human review, time delay).

- I-log ang lahat ng bagay: prompts, tool calls, inputs, outputs, at mga bersyon ng modelo.

5) Pamamahala & operational security—pa rin ang pinakamadaling daan papasok

Kahit ang pinakamahusay na code at mga modelo ay nabibigo kung:

- ang mga susi ay nakompromiso

- mahina ang deploy pipelines

- minamadali ang mga update

- walang monitoring

- ang incident response ay improvised

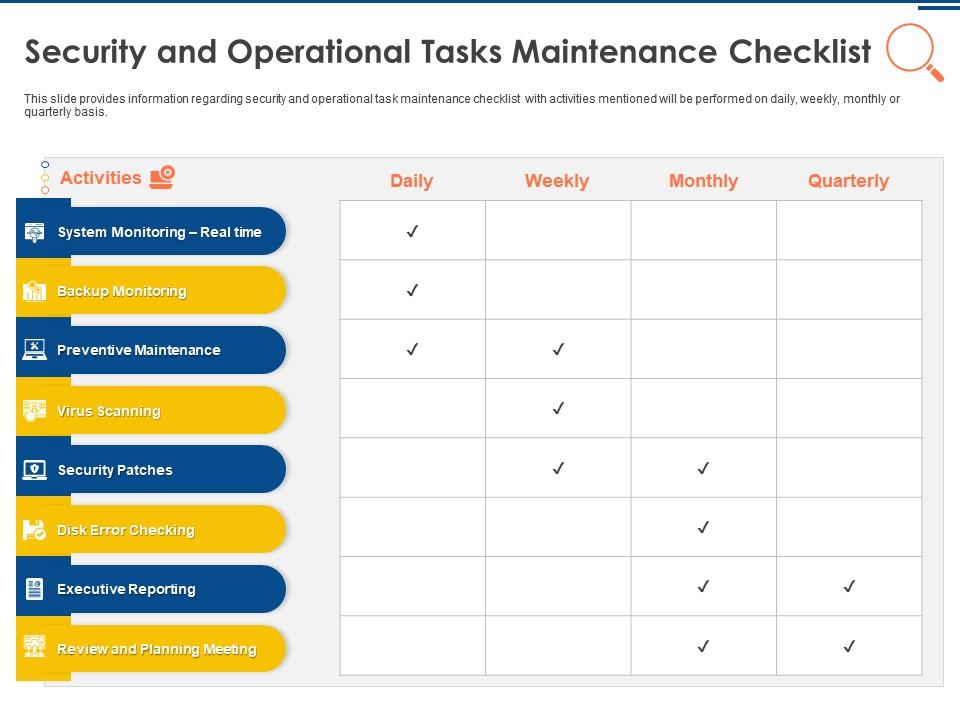

Mga Depensa

- Multisig + hardware keys + key rotation policy

- Timelocks para sa mga update; emergency actions na may mahigpit na saklaw

- 24/7 alerting at playbooks (ano ang nagti-trigger ng pause? sino ang pipirma?)

- Post-mortems at transparent na disclosures kapag may insidente

Gaano ka-secure ang mga cryptocurrency na batay sa artipisyal na intelihensiya, talagang?

Isang praktikal na pagsusuri (mga tagapagbuo + mga mamumuhunan)

Gamitin ang checklist na ito upang magbigay ng marka sa mga tunay na proyekto. Hindi mo kailangan ng perpektong sagot—kailangan mo ng nasusukat na ebidensya.

A. Mga kontrol sa on-chain (kailangang mayroon)

- Audits: ang mga audit ba ay kamakailan at may kinalaman sa kasalukuyang code na na-deploy?

- Disenyo ng pag-upgrade: timelock? multisig? emergency pause?

- Mga limitasyon: max leverage, rate limits, max parameter change bawat epoch?

- Pagsubaybay: mga pampublikong dashboard, alerto, at kasaysayan ng insidente?

B. Integridad ng datos at oracle (kritikal para sa AI)

- Ang mga pinagkukunan ng datos ba ay iba-iba at pinapatunayan ng iba?

- Ang provenance ng dataset ba ay nasusubaybayan (mga hash, bersyon, mga log ng pagbabago)?

- Mayroon bang proteksyon laban sa manipulasyon (matibay na aggregation, mga filter, pagsusuri ng anomalyo)?

C. Pamamahala ng modelo (tukoy sa AI)

- Ang modelo ba ay may bersyon at maaaring ma-reproduce?

- Mayroon bang model card: mga tampok na ginamit, kilalang limitasyon, iskedyul ng retraining?

- Isinasagawa ba ang adversarial testing (pag-poison, evasion, pagbabago ng distribusyon)?

D. Kaligtasan ng ahente (kung ang mga ahente ay nagsasagawa ng mga aksyon)

- Ang mga permiso ba ay minimal at hiwalay?

- Ang mga tawag sa tool ba ay pinaghihigpitan ng mga allowlist?

- Mayroon bang mga aprubadong tao para sa mga mataas na epekto ng aksyon?

E. Kaligtasan sa ekonomiya at insentibo

- Ang mga insentibo ba ay nakahanay upang hindi kumita ang mga kalahok mula sa pagpapasama ng modelo?

- Mayroon bang slashing o reputasyon para sa mga maling kontribusyon sa datos?

- Mayroon bang malinaw na mga failure modes (ano ang mangyayari kung bumagsak ang kumpiyansa ng modelo)?

Isang simpleng pamaraan ng pagsusuri

Magbigay ng 0–2 puntos bawat kategorya (0 = hindi alam/hindi ligtas, 1 = bahagya, 2 = matibay na ebidensya). Ang isang proyektong nakakakuha ng <6/10 ay dapat tratuhin bilang "eksperimental" anuman ang marketing.

- Mga kontrol sa on-chain (0–2)

- Datos/oracles (0–2)

- Pamamahala ng modelo (0–2)

- Kaligtasan ng ahente (0–2)

- Insentibo/ekonomiya (0–2)

Mga Defensive na pattern ng arkitektura na talagang gumagana

Narito ang mga pattern na ginagamit sa mga high-assurance na sistema, na inangkop para sa AI-based na crypto:

Pattern 1: “AI ang nagmumungkahi, deterministic na mga patakaran ang nagdedesisyon”

Hayaan ang modelo na magmungkahi ng mga parameter (mga risk tier, pagbabago sa fee), ngunit ipatupad ang mga pagbabago gamit ang deterministic na mga constraint:

- nakatakdang mga update (±x% kada araw)

- quorum checks (dapat magkakasundo ang mga modelo)

- confidence thresholds (ang aksyon ay nangangailangan ng

p > threshold)

- cooldown windows

Bakit ito gumagana: kahit na mali ang modelo, ang protocol ay magfa-fail ng maayos.

Pattern 2: Multi-source, multi-model na consensus

Sa halip na umasa sa isang modelo, gumamit ng ensemble checks:

- iba't ibang mga arkitektura

- iba't ibang mga training window

- iba't ibang mga data provider

Pagkatapos, kailangan ng consensus (o kailangan na ang “disagreement score” ay mababa sa isang limitasyon).

Bakit ito gumagana: mas mahirap magpoison ng isang landas.

Pattern 3: Secure na supply chain ng data

Ituring ang mga dataset tulad ng code:

- nilagdaang mga release

- mga hash ng integridad

- mga kontrol sa pag-access

- mga review gates

Bakit ito gumagana: karamihan sa mga atake sa AI ay mga atake sa data.

Pattern 4: Partitioning ng permiso ng agent

Paghiwalayin:

- Research agent (nagbabasa, nagbubuod, nagfo-forecast)

- Execution agent (limitadong, allowlisted na mga aksyon)

- Policy guard (nagsusuri ng mga constraint bago magsagawa)

Bakit ito gumagana: nagiging hindi gaanong malala ang prompt injection.

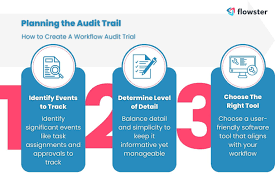

Hakbang-hakbang: Paano magsagawa ng audit sa isang AI-based na crypto na proyekto (mabilis pero seryoso)

- I-map ang mga landas ng paglipat ng halaga

- Ilista ang bawat function ng kontrata na gumagalaw ng pondo o nagbabago ng mga patakaran ng collateral.

- Kilalanin ang mga AI na dependencies

- Aling mga desisyon ang umaasa sa mga output ng AI? Ano ang mangyayari kung mali ang mga output?

- Subaybayan ang data pipeline

- Para sa bawat feature: pinagmulan → transformation → storage → input ng modelo.

- Subukan ang manipulasyon

- I-simulate ang wash trading, extreme volatility, sentiment spam, mga outage ng API.

- Suriin ang pamamahala ng modelo

- Pag-version, mga trigger ng retraining, pagmamanman ng drift, plano ng rollback.

- Suriin ang mga pahintulot ng agent

- Mga tool, susi, allowlist, rate limit, mga aprubadong aksyon.

- Tiyakin ang pagmamanman at tugon

- Sino ang makakatanggap ng abiso? Ano ang magtutulak sa mga circuit breaker? May mga playbook ba na nakasulat?

- Suriin ang mga insentibo

- Mayroon bang sinuman na kumikita sa pamamagitan ng pagpaparumi, spamming, o pagpapabagsak ng mga signal?

Pro tip: Ang isang estrukturadong workflow sa pananaliksik ay makakatulong upang maiwasan mong makalimutan ang mga link sa pagitan ng mga layer. Halimbawa, ang estilo ng multi-agent analysis ng SimianX AI ay maaaring gamitin upang paghiwalayin ang mga assumptions, magsagawa ng mga cross-check, at panatilihin ang isang auditable na "decision trail" kapag nire-review ang mga AI-driven na crypto system—lalo na kapag mabilis magbago ang mga narrative at data.

Karaniwang “security theater” red flags sa AI-based na crypto

Pansinin ang mga pattern na ito:

- “AI” ay isang buzzword na walang malinaw na modelo, data, o deskripsyon ng failure mode.

- Walang pagtalakay sa data provenance o pagmamanipula ng oracle.

- “Autonomous agents” na may direktang signing power at walang mga guardrail.

- Madalas na mga upgrade na walang timelock o hindi malinaw na kontrol ng admin.

- Mga claim sa performance na walang metodolohiya ng evaluasyon (walang backtests, walang out-of-sample, walang drift tracking).

- Pamamahala na nakatutok sa ilang wallets na walang transparency.

Ang seguridad ay hindi isang listahan ng mga tampok. Ito ay ebidensya na ang isang sistema ay bumabagsak ng ligtas kapag ang mundo ay kumikilos ng adversarially.

Mga praktikal na tool at workflow (kung saan akma ang SimianX AI)

Kahit na may solidong teknikal na kontrol, kailangan pa rin ng mga mamumuhunan at koponan ng mga paulit-ulit na paraan upang suriin ang panganib. Ang isang magandang workflow ay dapat:

- ihambing ang mga claim laban sa beripikadong on-chain na ugali

- subaybayan ang mga assumption (mga pinagmumulan ng data, bersyon ng modelo, mga threshold)

- dokumentuhin ang “ano ang magbabago ng aking isip?”

- paghiwalayin ang signal mula sa kwento

Maaari mong gamitin ang SimianX AI bilang isang praktikal na balangkas upang ayusin ang prosesong iyon—lalo na sa pamamagitan ng pag-organisa ng mga tanong sa panganib, integridad ng data, pamamahala ng modelo, at mga hadlang sa pagpapatupad, at sa pamamagitan ng paggawa ng pare-parehong mga tala ng pananaliksik. Kung ikaw ay naglalathala ng nilalaman para sa iyong komunidad, makakatulong ang mga link ng sumusuportang pananaliksik upang matulungan ang mga gumagamit na gumawa ng mas ligtas na desisyon (tingnan ang SimianX na kwento ng crypto workflow hub para sa mga halimbawa ng mga estrukturadong pamamaraang pagsusuri).

FAQ Tungkol sa Seguridad ng mga Cryptocurrency na Batay sa Artipisyal na Intelihensiya

Ano ang pinakamalaking panganib sa seguridad sa mga cryptocurrency na batay sa AI?

Karamihan sa mga pagkabigo ay nagmumula pa rin sa smart contract at operational security, ngunit nagdaragdag ang AI ng pangalawang uri ng pagkabigo: manipuladong data na nagdudulot ng “valid-looking” ngunit mapaminsalang mga desisyon. Kailangan mo ng mga kontrol para sa parehong mga layer.

Paano ko malalaman kung ang isang proyekto ng AI token ay tunay na gumagamit ng AI nang ligtas?

Maghanap ng mga ebidensya: versioning ng modelo, pinagmulan ng data, adversarial testing, at malinaw na mga failure modes (ano ang nangyayari kapag kulang ang data o mababa ang kumpiyansa). Kung wala sa mga ito ang dokumentado, ituring ang “AI” bilang marketing.

Paano magsagawa ng audit sa mga proyekto ng crypto na batay sa AI nang hindi binabasa ang libu-libong linya ng code?

Magsimula sa isang layered threat model: mga on-chain na kontrol, data/oracles, pamamahala ng modelo, at mga pahintulot ng agent. Kung hindi mo kayang i-map kung paano naaapektohan ng mga output ng AI ang paglipat ng halaga, hindi mo kayang suriin ang panganib.

Ligtas bang patakbuhin ang mga AI trading agent sa mga crypto market?

Maaaring ligtas, ngunit tanging sa pinakamababang pribilehiyo, mga awtorisadong aksyon, mga rate limit, at mga aprubadong hakbang mula sa tao para sa mga mataas na epekto na galaw. Huwag magbigay ng hindi limitadong awtoridad sa pag-pirma sa isang agent.

Ginagawa bang mas ligtas ng desentralisasyon ang AI sa crypto?

Hindi awtomatiko. Ang desentralisasyon ay maaaring magbawas ng mga single points of failure, ngunit maaari rin itong lumikha ng mga bagong attack surfaces (malicious na mga nag-aambag, kontaminadong data markets, mga pagsasamantala sa insentibo). Ang kaligtasan ay nakadepende sa pamamahala at mga insentibo.

Konklusyon

Ang seguridad ng mga cryptocurrency na batay sa AI ay nangangailangan ng mas malawak na pananaw kumpara sa mga tradisyunal na crypto audits: kailangan mong siguruhing ligtas ang code, data, models, agents, at governance bilang isang sistema. Ang mga pinakamahusay na disenyo ay nag-aassume na ang mga input ay may kalaban, nililimitahan ang pinsala ng maling mga output ng modelo, at nangangailangan ng maaring ulitin na ebidensya—hindi basta pakiramdam. Kung nais mong magkaroon ng paulit-ulit na paraan upang suriin ang mga AI-driven na crypto projects, bumuo ng isang checklist-driven na workflow at panatilihin ang isang malinaw na desisyon trail. Maaari mong tuklasin ang mga structured na pamamaraan ng pagsusuri at mga kasangkapan sa pananaliksik sa SimianX AI upang gawing mas konsistent at defensible ang iyong mga pagsusuri sa AI-crypto security.

Kaugnay na Babasahin

- AI Crypto Analysis: Praktikal na Gabay sa Trading 2026

- AI Crypto Analysis Workflow: Mula Data Hanggang Desisyon

- Time-Series vs LLM sa Cripto: Hybrid ang Panalo