La sécurité des cryptomonnaies basées sur l'intelligence artificielle

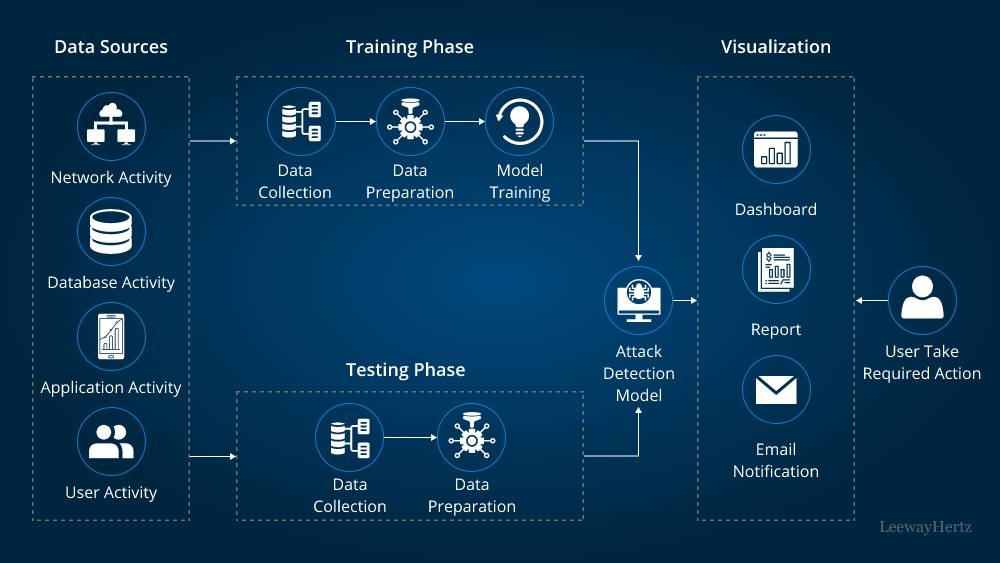

La sécurité des cryptomonnaies basées sur l'intelligence artificielle ne concerne plus seulement les contrats intelligents et les clés privées. Lorsqu'un jeton, un protocole ou un « produit crypto » dépend des modèles d'IA—prédiction des prix, évaluation des risques, création de marché automatisée, logique de liquidation, détection de fraude ou agents autonomes—vous héritez deux univers de sécurité en même temps : sécurité de la blockchain et sécurité IA/ML. La difficulté réside dans le fait que ces univers échouent de manière différente : les blockchains échouent bruyamment (exploits sur la chaîne), tandis que les systèmes IA échouent souvent discrètement (mauvaises décisions qui semblent « plausibles »). Dans ce guide, nous allons établir un modèle de menace pratique et un plan de défense que vous pouvez appliquer—plus montrer comment un flux de travail de recherche structuré (par exemple, en utilisant SimianX AI) vous aide à valider les hypothèses et à réduire les angles morts.

Qu'est-ce qu'une « cryptomonnaie basée sur l'IA » ?

Le terme « cryptomonnaie basée sur l'IA » est utilisé de manière vague en ligne, donc l'analyse de sécurité commence par une définition claire. En pratique, les projets tombent généralement dans une (ou plusieurs) des catégories suivantes :

- IA-dans-le-protocole : l'IA influence directement la logique sur la chaîne (par exemple, mises à jour des paramètres, frais dynamiques, limites de risque, facteurs de collatéral).

- IA comme oracle : un modèle hors chaîne produit des signaux qui alimentent les contrats (par exemple, volatilité, scores de fraude, niveaux de risque).

- Agents IA en tant qu'opérateurs : des bots autonomes gèrent la trésorerie, exécutent des stratégies ou effectuent des actions de maintien/liquidations.

- Écosystèmes de jetons IA : le jeton incite à la collecte de données, au calcul, à la formation de modèles, aux marchés d'inférence ou aux réseaux d'agents.

- Jetons de marque IA (axés sur le marketing) : dépendance minimale à l'IA ; le risque est principalement lié à la gouvernance, à la liquidité et aux contrats intelligents.

Point clé en matière de sécurité : plus les sorties d’IA affectent le transfert de valeur (liquidations, mint/burn, collatéral, mouvements de trésorerie), plus vous devez considérer le pipeline IA comme une infrastructure critique, et non comme de « simples analyses ».

Dès qu’une sortie de modèle peut déclencher des changements d’état on-chain, l’intégrité du modèle devient l’intégrité de l’argent.

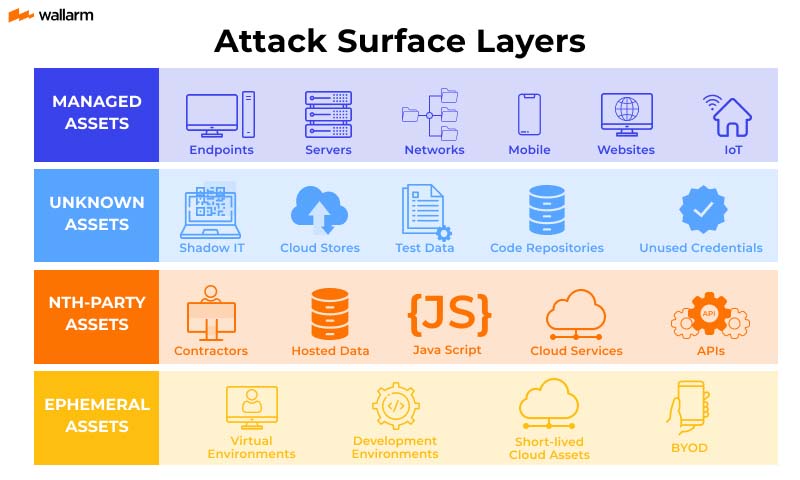

Un modèle de menace en couches pour la sécurité crypto basée sur l’IA

Un cadre utile consiste à traiter les systèmes crypto basés sur l’IA comme cinq couches imbriquées. Il faut des contrôles à chaque couche car les attaquants ciblent la plus faible.

| Couche | Ce qu'elle inclut | Mode de défaillance typique | Pourquoi c'est unique dans la crypto basée sur l'IA |

|---|---|---|---|

| L1 : Code on-chain | contrats, mises à jour, contrôle d’accès | bug exploitable, abus administrateur | le transfert de valeur est irréversible |

| L2 : Oracles & données | flux de prix, événements on-chain, API off-chain | entrées manipulées | l’IA dépend de la qualité des données |

| L3 : Modèle & entraînement | ensembles de données, étiquettes, pipeline d’entraînement | empoisonnement, portes dérobées | le modèle peut sembler « correct » mais être faux |

| L4 : Inférence & agents | endpoints, outils des agents, permissions | injection de prompt, abus d’outil | les « décisions » de l’agent peuvent être manipulées |

| L5 : Gouvernance & ops | clés, multisig, surveillance, réponse aux incidents | réaction lente, contrôles faibles | la plupart des « échecs IA » sont opérationnels |

Risques de sécurité principaux (et ce qui rend la crypto basée sur l’IA différente)

1) Les vulnérabilités des smart contracts restent dominantes — l’IA peut amplifier le rayon d’impact

Les problèmes classiques (réentrance, erreurs de contrôle d’accès, bugs de mise à jour, manipulation d’oracles, précision/arrondi, exposition MEV) restent #1. La particularité de l’IA est que l’automatisation pilotée par IA peut déclencher ces failles plus rapidement et plus fréquemment, surtout lorsque les agents opèrent 24h/24 et 7j/7.

Défenses

- Exiger des audits indépendants (idéalement multiples) et une surveillance continue.

- Préférer une autorité de mise à jour minimisée (verrouillages temporels, multi-signatures, pause d’urgence avec portée stricte).

- Ajouter des disjoncteurs pour les actions déclenchées par l’IA (limites de taux, plafonds de perte maximale, mises à jour paramétriques progressives).

- Maintenir les actions à haut risque derrière des approbations humaines lorsque la TVL est significative.

2) Oracles et manipulation de données—maintenant avec “empoisonnement compatible IA”

Les attaquants n’ont pas toujours besoin de casser la chaîne ; ils peuvent modifier les entrées du modèle :

- Wash trading pour influencer les signaux de volume/volatilité

- Spam social coordonné pour influencer les caractéristiques de sentiment

- Injection de motifs conçus pour manipuler les détecteurs d’anomalies

- Fournir de fausses étiquettes de “vérité terrain” dans des ensembles de données étiquetés par la communauté

Ceci est un empoisonnement de données, et c’est dangereux car le modèle peut continuer à passer les métriques normales tout en apprenant discrètement le comportement choisi par l’attaquant.

Défenses

- Utiliser une validation de données multi-sources (vérification croisée entre exchanges, plateformes on-chain, fournisseurs indépendants).

- Appliquer des statistiques robustes (moyennes tronquées, médiane des moyennes) et filtrage des valeurs aberrantes.

- Maintenir des ensembles de données signés et des journaux de provenance (hachage, versionnage, contrôles d’accès).

- Conserver un “ensemble doré” d’événements vérifiés pour détecter la dérive et l’empoisonnement.

Si vous ne pouvez pas prouver d’où proviennent les entrées du modèle, vous ne pouvez pas prouver pourquoi le protocole se comporte ainsi.

3) Attaques ML adversariales—évasion, portes dérobées et extraction de modèle

Les modèles d’IA peuvent être attaqués de façons qui ne ressemblent pas à des “hacks” traditionnels :

- Attaques d’évasion : entrées conçues pour contourner la détection de fraude ou le scoring de risque (par ex., perturbations du graphe de transactions).

- Portes dérobées : entraînement empoisonné provoquant des déclencheurs spécifiques produisant des sorties favorables à l’attaquant.

- Extraction de modèle : requêtes répétées pour approximer le modèle, puis l’exploiter ou concurrencer.

- Inférence de membership / fuite de confidentialité : le modèle révèle si certains points de données faisaient partie de l’entraînement.

Défenses

- Modéliser les menaces du modèle : quelles sorties sont sensibles, qui peut interroger, quels sont les limites de fréquence existantes ?

- Renforcer les points de terminaison d’inférence :

limitation de débit, authentification, détection d’anomalies, budgets de requêtes.

- Effectuer une évaluation red-team avec des tests adversariaux avant le lancement et après les mises à jour.

- Pour les données d’entraînement sensibles : envisager la confidentialité différentielle, des enclaves sécurisées ou des ensembles de fonctionnalités restreints.

4) Injection de prompt et abus d’outils chez les agents IA

Si les agents peuvent appeler des outils (trader, transférer, signer, publier la gouvernance, mettre à jour des paramètres), ils peuvent être attaqués via :

- des entrées malveillantes qui poussent l’agent à effectuer des actions nuisibles

- un « détournement d’instruction » via du contenu externe (pages web, messages Discord, PDF)

- un mauvais usage des outils (appel de la mauvaise fonction avec une charge utile semblant correcte)

Défenses

- Moindre privilège : les agents ne doivent pas avoir une autorité de signature illimitée.

- Séparer les permissions : distinguer “analyse” de “exécution”.

- Utiliser des listes blanches pour les outils et destinations (contrats approuvés, chaînes, routes).

- Exiger des confirmations pour les actions à haut risque (seuil multisig, revue humaine, délai temporel).

- Tout enregistrer : prompts, appels d’outils, entrées, sorties et versions du modèle.

5) Gouvernance & sécurité opérationnelle — toujours le moyen le plus facile d’entrer

Même le meilleur code et les meilleurs modèles échouent si :

- les clés sont compromises

- les pipelines de déploiement sont faibles

- les mises à jour sont précipitées

- la surveillance fait défaut

- la réponse aux incidents est improvisée

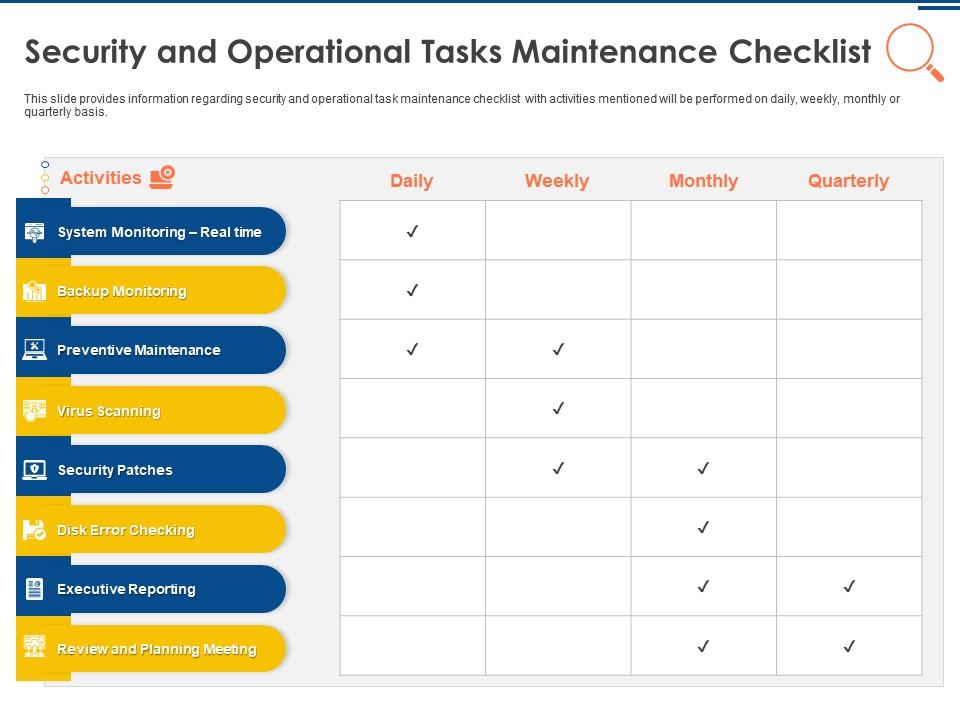

Défenses

- Multisig + clés matérielles + politique de rotation des clés

- Verrous temporels pour les mises à jour ; actions d’urgence avec périmètre strict

- Alertes 24/7 et playbooks (qu’est-ce qui déclenche une pause ? qui signe ?)

- Post-mortems et divulgations transparentes en cas d’incidents

Quelle est la véritable sécurité des cryptomonnaies basées sur l'intelligence artificielle ?

Un cadre d'évaluation pratique (constructeurs + investisseurs)

Utilisez cette liste de vérification pour évaluer des projets réels. Vous n'avez pas besoin de réponses parfaites — vous avez besoin de preuves falsifiables.

A. Contrôles on-chain (indispensables)

- Audits : les audits sont-ils récents et pertinents par rapport au code actuellement déployé ?

- Conception des mises à jour : verrouillage temporel ? multisig ? pause d'urgence ?

- Limites : levier maximum, limites de taux, changement maximal des paramètres par époque ?

- Surveillance : tableaux de bord publics, alertes et historique des incidents ?

B. Intégrité des données et des oracles (crucial pour l'IA)

- Les sources de données sont-elles diversifiées et croisées ?

- La provenance des ensembles de données est-elle tracée (haches, versions, journaux des modifications) ?

- Existe-t-il une résistance à la manipulation (agrégations robustes, filtres, vérifications des anomalies) ?

C. Gouvernance du modèle (spécifique à l'IA)

- Le modèle est-il versionné et reproductible ?

- Existe-t-il une fiche du modèle : fonctionnalités utilisées, limitations connues, calendrier de réentraînement ?

- Des tests adversariaux sont-ils réalisés (empoisonnement, évasion, changement de distribution) ?

D. Sécurité des agents (si des agents exécutent des actions)

- Les autorisations sont-elles minimales et séparées ?

- Les appels aux outils sont-ils restreints par des listes blanches ?

- Des approbations humaines sont-elles requises pour les actions à fort impact ?

E. Sécurité économique et des incitations

- Les incitations sont-elles alignées de manière à ce que les participants ne profitent pas de l'empoisonnement du modèle ?

- Y a-t-il des sanctions ou une réputation pour les contributions malveillantes de données ?

- Existe-t-il des modes de défaillance clairs (que se passe-t-il si la confiance dans le modèle s'effondre) ?

Une méthode de notation simple

Attribuez 0 à 2 points par catégorie (0 = inconnu/insécurisé, 1 = partiel, 2 = preuves solides). Un projet ayant un score <6/10 doit être traité comme « expérimental » quel que soit le marketing.

- Contrôles on-chain (0–2)

- Données/oracles (0–2)

- Gouvernance du modèle (0–2)

- Sécurité des agents (0–2)

- Incitations/économie (0–2)

Modèles d'architecture défensive qui fonctionnent réellement

Voici des modèles utilisés dans les systèmes à haute sécurité, adaptés pour la crypto basée sur l'IA :

Modèle 1 : « L'IA suggère, les règles déterministes décident »

Laissez le modèle proposer des paramètres (niveaux de risque, changements de frais), mais appliquez les changements avec des contraintes déterministes :

- mises à jour limitées (±x% par jour)

- vérifications de quorum (doivent être cohérentes entre plusieurs modèles)

- seuils de confiance (l'action nécessite

p > seuil)

- fenêtres de refroidissement

Pourquoi cela fonctionne : même si le modèle est erroné, le protocole échoue gracieusement.

Modèle 2 : Consensus multi-source, multi-modèle

Au lieu de se fier à un seul modèle, utilisez des vérifications en ensemble :

- différentes architectures

- différentes fenêtres d'entraînement

- différents fournisseurs de données

Ensuite, exigez un consensus (ou exigez que le « score de désaccord » soit en dessous d'une limite).

Pourquoi cela fonctionne : empoisonner un chemin devient plus difficile.

Modèle 3 : Chaîne d'approvisionnement des données sécurisée

Traitez les ensembles de données comme du code :

- versions signées

- hachages d'intégrité

- contrôles d'accès

- portes de révision

Pourquoi cela fonctionne : la plupart des attaques en IA sont des attaques sur les données.

Modèle 4 : Partitionnement des permissions des agents

Séparez :

- Agent de recherche (lit, résume, prévoit)

- Agent d'exécution (actions limitées, autorisées par liste blanche)

- Gardien des politiques (vérifie les contraintes avant l'exécution)

Pourquoi cela fonctionne : l'injection de prompts devient moins fatale.

Étape par étape : Comment auditer un projet crypto basé sur l'IA (rapide mais sérieux)

- Cartographier les chemins de transfert de valeur

- Listez chaque fonction de contrat qui déplace des fonds ou modifie les règles de collatéral.

- Identifier les dépendances en IA

- Quelles décisions dépendent des sorties de l'IA ? Que se passe-t-il si les sorties sont erronées ?

- Suivre le pipeline de données

- Pour chaque fonctionnalité : source → transformation → stockage → entrée du modèle.

- Tester la manipulation

- Simuler le trading de lavage, une volatilité extrême, le spam de sentiment, les pannes d'API.

- Réviser la gouvernance du modèle

- Versionnage, déclencheurs de réentraînement, surveillance des dérives, plan de retour arrière.

- Inspecter les autorisations des agents

- Outils, clés, listes blanches, limites de taux, approbations.

- Valider la surveillance et la réponse

- Qui reçoit des alertes ? Qu'est-ce qui déclenche les disjoncteurs ? Les playbooks sont-ils rédigés ?

- Évaluer les incitations

- Quelqu'un profite-t-il de l'empoisonnement, du spam ou de la déstabilisation des signaux ?

Astuce professionnelle : Un flux de travail de recherche structuré vous aide à éviter de manquer des liens entre les couches. Par exemple, l'analyse multi-agents de type SimianX AI peut être utilisée pour séparer les hypothèses, effectuer des vérifications croisées et maintenir une "piste de décision" vérifiable lors de l'évaluation des systèmes cryptographiques pilotés par IA—surtout lorsque les narratifs et les données changent rapidement.

Signaux d'alerte courants de la “sécurité théâtrale” dans les crypto-monnaies basées sur l'IA

Soyez vigilant face à ces modèles :

- “L'IA” est un mot à la mode sans modèle clair, données ou description des modes de défaillance.

- Aucune discussion sur la provenance des données ou la manipulation des oracles.

- “Agents autonomes” avec pouvoir de signature direct et sans garde-fous.

- Mises à jour fréquentes sans verrouillage temporel ou contrôle administratif flou.

- Revendications de performance sans méthodologie d'évaluation (pas de backtests, pas d'échantillons externes, pas de suivi des dérives).

- Gouvernance concentrée dans quelques portefeuilles sans transparence.

La sécurité n'est pas une liste de fonctionnalités. C'est la preuve qu'un système échoue de manière sécurisée lorsque le monde se comporte de manière antagoniste.

Outils pratiques et flux de travail (où SimianX AI s'intègre)

Même avec des contrôles techniques solides, les investisseurs et les équipes ont toujours besoin de moyens reproductibles pour évaluer les risques. Un bon flux de travail devrait :

- comparer les revendications par rapport au comportement vérifiable sur la blockchain

- suivre les hypothèses (sources de données, versions des modèles, seuils)

- documenter “ce qui changerait mon avis ?”

- séparer le signal de l'histoire

Vous pouvez utiliser SimianX AI comme un cadre pratique pour structurer ce processus — notamment en organisant les questions en risques, intégrité des données, gouvernance des modèles et contraintes d'exécution, et en produisant des notes de recherche cohérentes. Si vous publiez du contenu pour votre communauté, lier des recherches de soutien aide les utilisateurs à prendre des décisions plus sûres (voir le hub d'histoires de workflow crypto de SimianX pour des exemples d'approches d'analyse structurée).

FAQ sur la sécurité des cryptomonnaies basées sur l'intelligence artificielle

Quel est le plus grand risque de sécurité dans les cryptomonnaies basées sur l'IA ?

La plupart des échecs proviennent encore de la sécurité des contrats intelligents et opérationnelle, mais l'IA ajoute un second mode d'échec : les données manipulées qui entraînent des décisions "valables en apparence" mais nuisibles. Il vous faut des contrôles pour les deux couches.

Comment savoir si un projet de jeton IA utilise réellement l'IA de manière sécurisée ?

Cherchez des preuves : gestion des versions des modèles, provenance des données, tests adversariaux, et modes de défaillance clairs (que se passe-t-il lorsque les données sont manquantes ou la confiance est faible). Si aucune de ces informations n'est documentée, traitez l'“IA” comme du marketing.

Comment auditer des projets crypto basés sur l'IA sans lire des milliers de lignes de code ?

Commencez par un modèle de menace en couches : contrôles sur chaîne, données/oracles, gouvernance des modèles, et permissions des agents. Si vous ne pouvez pas cartographier comment les sorties de l'IA influencent le transfert de valeur, vous ne pouvez pas évaluer le risque.

Les agents de trading IA sont-ils sûrs à utiliser sur les marchés crypto ?

Ils peuvent l'être, mais uniquement avec le moindre privilège, des actions sur liste blanche, des limites de taux, et des approbations humaines pour les mouvements à fort impact. Ne jamais donner à un agent une autorité de signature sans restriction.

La décentralisation rend-elle l'IA plus sûre dans les cryptomonnaies ?

Pas automatiquement. La décentralisation peut réduire les points de défaillance uniques, mais elle peut aussi créer de nouvelles surfaces d'attaque (contributeurs malveillants, marchés de données empoisonnées, exploitations d'incitations). La sécurité dépend de la gouvernance et des incitations.

Conclusion

La sécurité des cryptomonnaies basées sur l'IA exige un état d'esprit plus large que celui des audits de cryptomonnaies traditionnels : vous devez sécuriser le code, les données, les modèles, les agents et la gouvernance en tant que système unique. Les meilleures conceptions supposent que les entrées sont adversariales, limitent les dommages des sorties incorrectes des modèles, et nécessitent des preuves reproductibles — pas des impressions. Si vous voulez une manière répétable d’évaluer les projets de cryptomonnaies pilotés par l'IA, construisez un flux de travail basé sur une liste de contrôle et conservez une trace claire des décisions. Vous pouvez explorer des approches d'analyse structurée et des outils de recherche sur SimianX AI pour rendre vos évaluations de sécurité des IA-cryptomonnaies plus cohérentes et défendables.

Lecture Liée

- Analyse Crypto par IA : Guide Pratique de Trading 2026

- Workflow Analyse Crypto IA : Données vers Décisions

- Time-Series vs LLM en Crypto : l'Hybride l'emporte